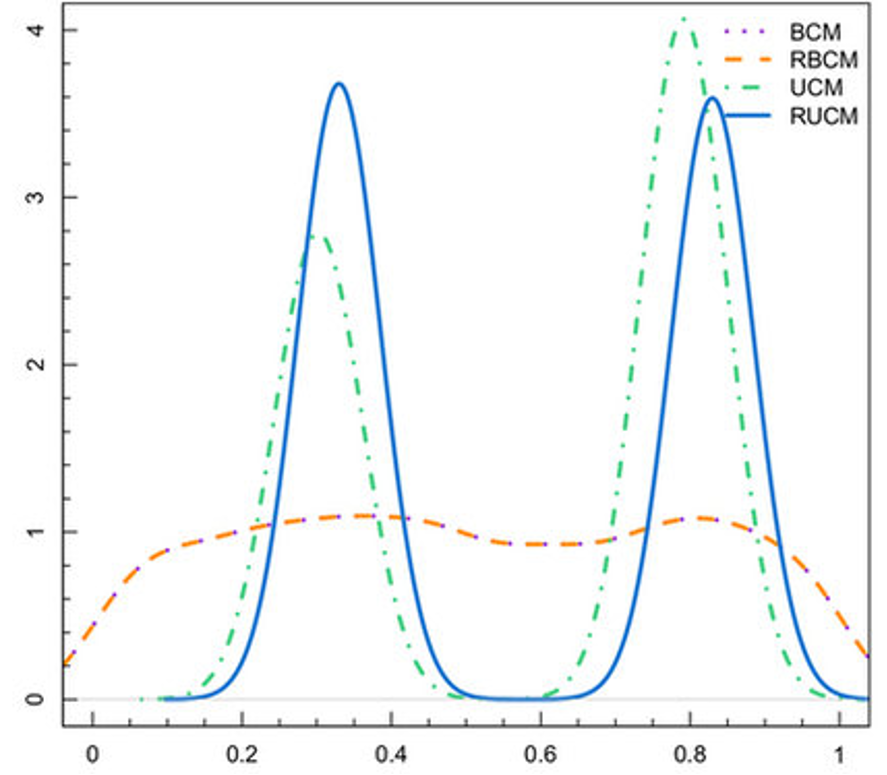

Los modelos matemáticos que intentan predecir la dinámica social de las opiniones ya no buscan explicar el consenso.Los modelos matemáticos para la dinámica de las opiniones en la sociedad tenían casi siempre como objetivo la explicación de la aparición del consenso, es decir, un estado del sistema en el que todas las personas tendrían una opinión parecida. Esto se consigue con modelos en los que una persona sólo interacciona con aquellas que no tienen una opinión demasiado distante, y el resultado de esa interacción es una cierta atracción hacia la opinión de la persona con la que interacciona. Los tiempos han cambiado, y ya no se trata de alcanzar un consenso, sino de decorar las paredes de nuestra cámara de eco con "hechos alternativos". Por tanto, lo que tienen que explicar ahora los modelos de opinión es la aparición de dos comunidades separadas, con opiniones extremadamente distintas. Un nuevo ejemplo de este fenómeno lo podemos encontrar en un artículo reciente de Michela del Vicario, Fabiana Zollo, Guido Caldarelli, Antonio Scala y Walter Quattrociocchi, investigadores de la Escuela de Estudios Avanzados sobre Instituciones, Mercados y Tecnología de Lucca, Italia, sobre los que ya he tenido ocasión de hablar aquí. El artículo se titula "La anatomía del debate sobre el Brexit en Facebook" ("The anatomy of Brexit debate on Facebook") y pueden encontrar una versión de acceso libre aquí. Tras analizar sistemáticamente con algoritmos de aprendizaje automático ("machine learning") cientos de miles de entradas de medios ingleses en Facebook relacionadas con el Brexit (en los meses previos al referéndum), los investigadores italianos detectaron dos comunidades perfectamente diferenciadas, constituidas por el 40 y el 60 por ciento de los individuos, respectivamente, que apenas interaccionan o comentan lo que ocurre en la otra comunidad. Estas comunidades constituyen universos paralelos en los que un mismo concepto provoca sentimientos completamente distintos, como demuestran también los resultados del estudio. La dinámica descrita en el párrafo anterior ha sido encontrada en muchos otros casos, algunos de los cuales hemos contado también aquí, y parece ser característica de los debates en las redes sociales en la actualidad. Por tanto, hay que buscar modelos matemáticos que sirvan para describir esta nueva realidad. Y eso es precisamente lo que hace este mismo grupo de investigadores (todos los mencionados más arriba salvo Fabiana Zollo, y con la ayuda de H. Eugene Stanley de la Universidad de Boston en EE.UU.) en otro artículo reciente aparecido en la revista Scientific Reports ("Modeling confirmation bias and polarization"). En estos nuevos modelos, no sólo hay "sesgo de confirmación" ("confirmation bias"), es decir, sólo atracción por aquellas opiniones suficientemente parecidas, sino también "polarización", esto es, repulsión por las opiniones discordantes. El resultado son las montañitas que pueden ver en la figura: comunidades simétricas, distantes, cercanas a los extremos. Bienvenidos a la era de la posverdad. Pónganse cómodos en su cámara de eco y disfruten del viaje. (Publicado originalmente en SciLogs el 06/02/2017).

0 Comments

Un grupo de investigadores italianos presenta herramientas capaces de detectar automáticamente una noticia falsa con una probabilidad del 91 %.Según el último informe del Instituto Reuters, el 51 % de los ciudadanos estadounidenses tiene ya como principal fuente de noticias a las redes sociales, incluyendo aplicaciones de mensajería como Whatsapp. En España (¡siempre en vanguardia!), el porcentaje llega al 58 %. De entre ellos, más de la mitad son incapaces de decir correctamente en qué medio leen en realidad las noticias: es decir, recuerdan haber leído la noticia "en Facebook" o "en Twitter", pero no saben decir de dónde ha salido la noticia. Conocer el medio y el autor es sin duda una información fundamental para poder juzgar críticamente el contenido, y también para hacer responsable a alguien de sus posibles inexactitudes. Facebook y Twitter no son responsables de nada. Así, se habrán fijado que últimamente es muy difícil discutir realmente sobre nada, ya que primero hay que dedicar un tiempo y un esfuerzo agotador a determinar cuáles son los datos y hechos (reales o inventados) que manejan los interlocutores. Muchas veces es tan difícil establecer un suelo fáctico común que, o bien la conversación acaba en sangre dialéctica, o bien nos refugiamos en el perezoso relativismo en el que todo es cuestión de opiniones y todas ellas son respetables. Los aspirantes a tiranos, claro, se frotan las manos: el viejo periodismo, el que ponía hombres sobre el terreno para desenmascarar sus mentiras y tonterías (el que se ve en "The Post", narrada con la brillantez habitual por el incurablemente optimista Spielberg) muere sepultado bajo un alud de chascarrillos, memes, zascas y cantos de pájaro. Las noticias falsas y el clima de posverdad son ya percibidos por la Unión Europea y otros gobiernos como las principales amenazas para el funcionamiento de la democracia, para la idea misma de la democracia (ya que sin información fáctica no manipulada, "toda libertad de opinión se convierte en una broma cruel", por citar otra vez a Hannah Arendt (Verdad y mentira en la política, Ed. Página Indómita 2017). ¿Qué hacer? Resistiendo la tentación de ser "apocalíptico" o "integrado", ya saben que en este blog nos gusta el "cauto dirigismo cultural" que proponía Eco. Es decir, que es necesario entender los mecanismos de la desinformación organizada, para poder buscar las mejores maneras de corregirlos y reformarlos. Como hemos venido contando aquí, a esto precisamente es a lo que lleva años dedicándose un grupo multidisciplinar de físicos, matemáticos e informáticos italianos. Su último trabajo acaba de aparecer en el arXiv: "Polarization and fake news: early warning of potential misinformation targets", de Michela del Vicario, Walter Quattrociocchi, Antonio Scala y Fabiana Zollo, de las Universidades de Venecia, Roma y el Instituto IMT de Estudios Avanzados de Lucca. En él se desarrollan herramientas para la prevención y detección de noticias falsas, en concreto en Facebook (aunque las técnicas son también aplicables a otras plataformas). Es bien sabido que los procesos de verificación ("fact-checking") y desenmascaramiento ("debunking") no sólo son lentos y costosos, sino que pueden ser contraproducentes, ya que en un clima altamente polarizado pueden irónicamente contribuir a reforzar la fe en un prejuicio equivocado. Sería estupendo que los programas de aprendizaje automático ("machine learning") fueran capaces de detectar las noticias falsas a partir de datos "estructurales" del mensaje en sí mismo, por ejemplo, número de "me gusta" y comentarios, velocidad de propagación etc. Sin embargo, eso no es posible: trabajos anteriores (incluido alguno de este grupo de investigadores) han mostrado que la información falsa tiene características estructurales muy parecidas a las de la información verdadera. Por tanto, es preciso también extraer información sobre el contenido del mensaje: existen herramientas que pueden extraer automáticamente datos sobre el contenido "semántico" de un mensaje (número de palabras, de letras mayúsculas etc.) y sobre el "sentimiento" del mensaje (si expresa una opinión positiva sobre un tema o negativa). En este trabajo, los investigadores usaron estas herramientas con un conjunto de varios cientos de miles de mensajes extraídos del Facebook en italiano durante los meses de julio a diciembre de 2016, tanto de sitios oficiales de noticias como de sitios de información (¡ay!) "alternativa". Los objetivos eran dos: a) detectar "temas" (lugares, nombres, instituciones etc.) muy susceptibles de aparecer en "fake news". Esto serviría para poder emitir avisos sobre determinados temas, que deberían ser tratados con especial cautela por el ciudadano. b) detectar directamente una noticia falsa. En a), la herramienta mencionada extrae los temas y les asigna una puntuación (desde -1 si el sentimiento es negativo hasta 1 si el sentimiento es positivo). A partir de esas puntuaciones, los investigadores definen ciertas características que se pueden calcular matemáticamente: por ejemplo, la "distancia de presentación", esto es, la diferencia entre la nota más positiva y la más negativa de entre todas las notas de sentimiento obtenidas por los mensajes en los que aparece un tema determinado. A partir de estas cantidades, los algoritmos de aprendizaje automático intentan clasificar los temas entre temas "fake" y temas "no fake". El resultado es que los mejores algoritmos son capaces de acertar en torno al 80 % de las veces. Este resultado es posible gracias a la introducción de las características semánticas y de sentimiento: en concreto, los investigadores muestran que la cantidad más útil es precisamente la distancia de presentación. Cuanto más pequeña es esa cantidad (es decir, más parecida es la respuesta de los usuarios a un determinado contenido), más alta es la probabilidad de que estemos ante un tema que tiene mucha probabilidad de ser parte de noticias falsas. (Pensemos que una distancia de presentación muy pequeña es característica de una cámara de eco, en la que todo el mundo piensa igual sobre los mismos temas). En b), se usa, por un lado, toda la información que se usó para a), pero esta vez calculada sobre las noticias en sí mismas (no sobre los temas), y por otro lado la propia información obtenida en a) (es decir, si el mensaje contiene, digamos, cuatro temas, se incluye el dato de que, digamos, tres de ellos, han sido clasificados como temas "fake"). Con toda esta información, se le pide ahora al programa que clasifique los mensajes como noticias falsas o verdaderas. Con el mejor algoritmo, e incluyendo toda la información, el porcentaje de acierto llega a ser tan alto como un 91 %. El resultado es esperanzador, y abre el camino de una detección rápida y sistemática de la desinformación maliciosa. (Publicado originalmente en SciLogs el 14/02/2018).

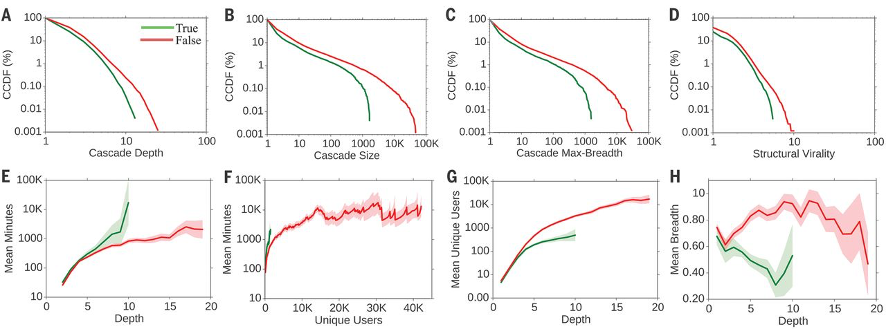

Conclusiones de un importante estudio sobre noticias falsas publicado en Science. La revista Science acaba de publicar "The spread of true and false news online" de los investigadores del MIT Soroush Vosoughi, Deb Roy y Sinan Aral. Destaca por ser el trabajo más ambicioso sobre la cuestión de la desinformación organizada, que hemos venido siguiendo en este cuaderno de bitácora en los últimos años. Otros estudios de los que nos hemos hecho eco anteriormente se centraban en temas o sitios concretos, y sus análisis se restringían a unos pocos meses o años. En este caso, en cambio, se analizan absolutamente todas las afirmaciones ("asserted claims") realizadas en Twitter desde su fundación que puedan clasificarse como verdaderas, falsas o parcialmente verdaderas, de acuerdo al criterio de seis organizaciones de verificación ("fact-checking") independientes. Las únicas limitaciones son: la plataforma (la sobrevalorada -bueno, cada vez menos- empresa de Zuckerberg no accede a participar en este tipo de estudios) y el idioma, que es sólo el inglés. El objetivo es, por tanto, nada menos que comprobar las diferencias en la difusión de la verdad y la mentira, con la máxima generalidad posible. Estamos hablando de unas 126.000 "cascadas de rumores" (la cadena de tuiteos y retuiteos relacionada con una afirmación) difundidas por más de 3 millones de personas unos 4,5 millones de veces. ¿Tendría razón Jonathan Swift cuando, hace más de trescientos años afirmaba que "la falsedad vuela, y la verdad viene cojeando detrás"? Parece que sí. Las conclusiones del estudio son, en resumen, que las mentiras son capaces de llegar a más gente y más rápido que la verdad. Las "mejores mentiras" son capaces de involucrar en sus tuiteos y retuiteos a un número de personas que nunca es alcanzado por ninguna verdad, y lo hacen a un ritmo varias veces superior. Según los investigadores, esto no está relacionado con el hecho de que los usuarios que difunden falsedades alcancen a más gente o sean más activos, ya que de hecho sus resultados muestran lo contrario. Su hipótesis es que las informaciones falsas tienen algo que las hace más "novedosas". Efectivamente, mediante un análisis de los sentimientos que se expresan en las distintas cadenas de rumores, se ve que en las cadenas falsas aparece más el sentimiento de sorpresa, mientras que en las verdaderas aparece más la tristeza (lo cual coincide con la intuición de que la verdad es triste, aunque aquí tal vez convenga recordar a Serrat cuando cantaba que "nunca es triste la verdad, lo que no tiene es remedio"). Algo hay en la mentira que nos resulta más atractivo, y eso hace que el número de falsedades aumente cada año (impresión que también confirman los datos del estudio) y tenga picos alrededor de los acontencimientos políticos más relevantes, como las elecciones estadounidenses. Esto nos ocurre, claro, sólo a los humanos: cuando se sustraen los datos que vienen de las cuentas robotizadas, nada varía en cuanto a las diferencias entre verdad y mentira. Por supuesto, esto no quiere decir que los "bots" políticos no sean un problema, como se han apresurado a afirmar desde determinadas agendas ideológicas: el papel de los bots en el incremento de la polarización en temas concretos ha sido demostrado en otros estudios (por ejemplo, aquí). Pero sí que señala claramente nuestra responsabilidad. Así que, ¿qué les parece?, ¿dejamos de propagar mentiras? ¿Compartimos sólo aquello que está contrastado y verificado?

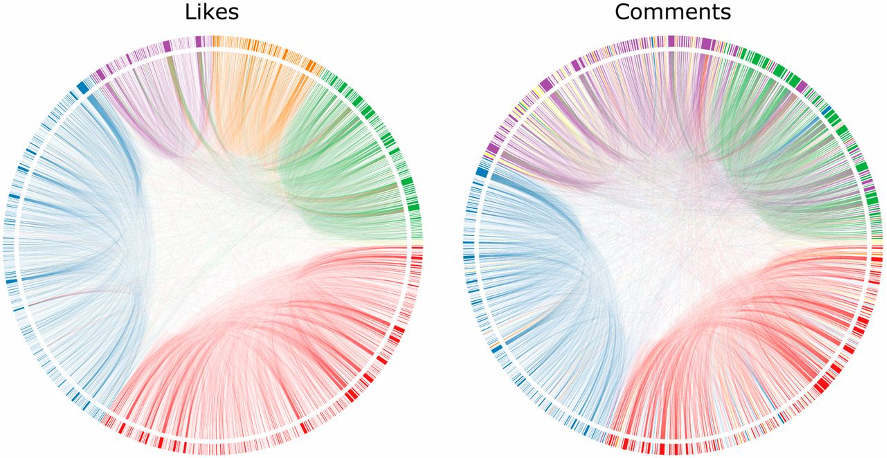

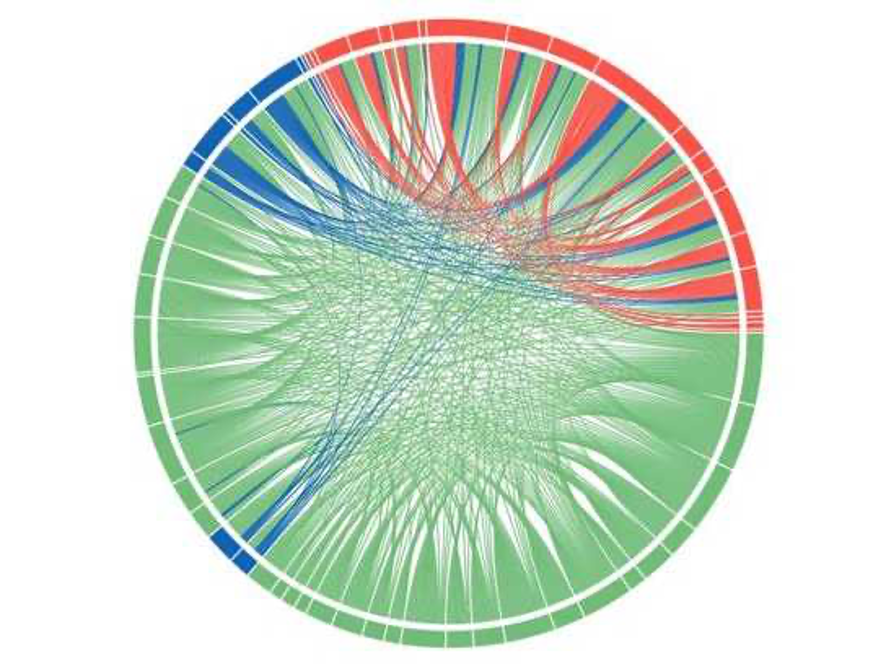

Yo llevo años abogando por esto, pero los resultados que suelo obtener en mi entorno son desoladores: cada que vez que le afeo a alguien que comparta una noticia que es demostrablemente falsa, contribuyendo así a su mayor difusión, me suelo encontrar con que nadie parece muy preocupado por el asunto: "ah, sí, lo he puesto ahí, pero ni lo había mirado, la verdad" (esto es algo así como "sí, apreté el gatillo, pero ¡no sabía que era una pistola!") o "vale, esto es falso, pero hay otra cosa que..." (en el fondo, nos dicen "esto es falso pero ¡debería ser verdadero!"). Todavía no somos conscientes de la importancia de este asunto, de nuestra gran responsabilidad. Salgan de las cámaras de eco, por favor, y miren el daño que estamos haciendo. (Publicado originalmente en SciLogs el 02/04/2018). Física, matemáticas e informática en el análisis de la desinformación en las redes sociales.Ya se habrán dado cuenta en las últimas semanas: posverdad es la palabra de moda, al menos entre los pocos lectores de periódicos que vamos quedando. No está en el diccionario de la RAE, pero su equivalente inglesa ha sido elegida palabra del año por el diccionario de Oxford. Varios fenómenos políticos muy significativos han llevado a una preocupación generalizada por la propagación indiscriminada de noticias falsas y de teorías de corte conspirativo sin fundamento en la realidad, pero de alcance creciente. Esta preocupación comienza a dirigir sus miradas hacia las compañías más poderosas del planeta (Facebook, Google etc.) y su controvertido papel en la promoción y difusión de la desinformación. En realidad, aunque el problema esté ahora en la primera plana, hace años que está sobre la mesa de muchos científicos, en relación con el fenómeno de las cámaras de eco: comunidades de usuarios con fuerte polarización ideológica y sentimental que apenas entran en contacto con el "mundo exterior" a ellas, lo cual refuerza la mencionada polarización y aumenta la exposición a la desinformación y la posverdad. Recientemente, Investigación y Ciencia publicó un interesantísmo artículo de Walter Quattrociocchi donde se resumen los resultados que su grupo de investigación en la Escuela de Estudios Avanzados sobre Instituciones, Mercados y Tecnología de Lucca, en Italia, y sus colaboradores han venido obteniendo en los últimos años, sobre "la dinámica del contagio social y el uso de contenidos en diversas redes sociales, como Facebook, Twitter y YouTube". Se trata de un grupo de científicos altamente interdisciplinar, compuesto por dos físicos, Guido Caldarelli y Antonio Scala; un estadístico, Alessandro Bessi; una matemática, Michaela Del Vicario; y dos informáticos, Fabiana Zollo y el propio Quattrociocchi. Esta combinación de habilidades matemáticas, físicas y computacionales es la adecuada para el análsis de este tipo de fenómenos. Tras la publicación del artículo en IyC, han seguido apareciendo resultados de la máxima urgencia e interés. Bessi, junto con Emilio Ferrara de la University of Southern California, analizó más de 20 millones de tuits emitidos por más de 2,8 millones de usuarios sobre las elecciones presidenciales en Estados Unidos en las semanas previas a la votación. Sus conclusiones publicadas en la revista First Monday y basadas en técnicas de "aprendizaje de máquinas" (machine learning) muestran que había unos 400.000 robots activos en la discusión, que produjeron casi 4 millones de tuits, es decir, cerca de un 20 % del total. El número de robots produciendo mensajes positivos a favor del candidato Trump fue muy superior al de aquellos que producían mensajes a favor de la candidata Clinton, lo cual evidentemente pudo distorsionar artificialmente la percepción sobre el apoyo real a los dos candidatos. En otro estudio, realizado por el grupo de Quattrociocchi para Il corriere della sera antes del reciente referendum realizado en Italia, los investigadores volvieron a confirmar la aparición de dos comunidades diferentes en Facebook, sin apenas contacto entre sí, repartidas aproximadamente entre un 70-80 % para una y 20-30 % para la otra. El estudio muestra que el 20 % de las interacciones con noticias sobre el referendum, eran interacciones con noticias falsas, que se relacionaban sobre todo con la comunidad minoritaria. Teniendo en cuenta que Facebook es la fuente principal de información para un número creciente de personas (el 35 % de los italianos, por ejemplo), los resultados son especialmente preocupantes, ya que sugieren que una cantidad nada despreciable de la población se informa casi exclusivamente con noticias falsas. Si esta tendencia continúa, la amenaza para los cimientos de la democracia es obvia: ¿tiene sentido que los habitantes de universos paralelos voten en las elecciones y referendos convocados en sólo uno de los universos? ¿No sería justo que usted, mi prudente lectora, y yo pudiéramos votar también en ese universo alternativo en el que las vacunas causan autismo, la wifi y los transgénicos dan alergias, el papa pide el voto para Trump, y Clinton dirige una red de pederastia desde una pizzería? Me objetarás, oh lectora, que ese universo no existe. Y era exactamente eso lo que quería decir.

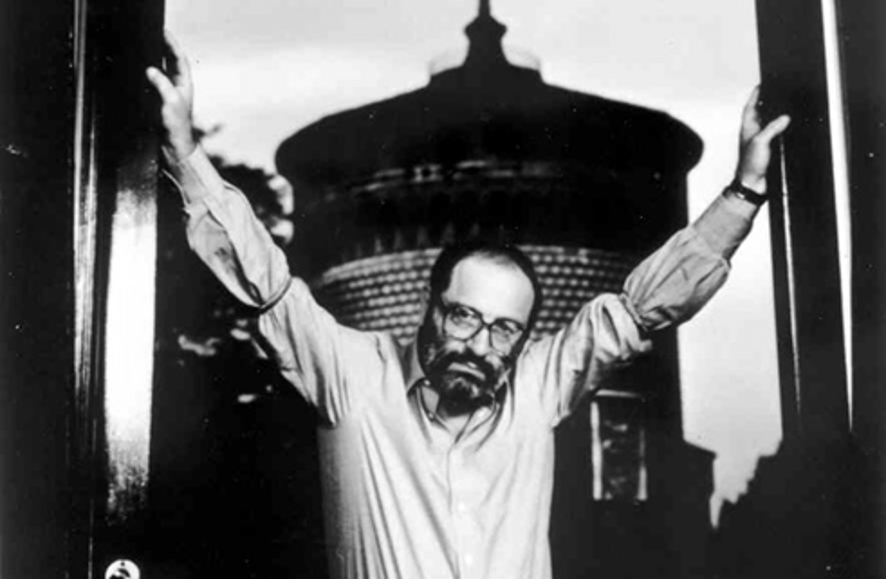

(Publicado originalmente en SciLogs el 16/12/2016). Enseñanzas del clásico de Umberto Eco para el tiempo presente. En 1964, el gran Umberto Eco publicó su célebre colección de ensayos Apocalípticos e integrados, en la que describió las dos actitudes más comunes de los académicos e intelectuales frente a la llamada "cultura de masas" (que entonces venía representada por la televisión, la música grabada, la literatura comercial y los tebeos de Superman, entre otros). Por un lado, los "vendedores del Apocalipsis" rechazarían de plano y por sistema cualquier fenómeno que entrara dentro de esa categoría. Por otro, los integrados lo celebrarían y saludarían como algo siempre positivo. Eco criticaba a los dos grupos: a los apocalípticos por su concepción "aristocrática" de la cultura, que condenaba cualquier avance tecnológico o cambio social que condujera a una mayor difusión de la cultura y el conocimiento; a los integrados por su aceptación acrítica y sin filtros de los defectos y problemas que esos cambios y avances generan. Aunque aparentemente contrarias, las dos actitudes conducirían al mismo resultado práctico (¿les suena?): pasividad intelectual que imposibilitaría cualquier intento de reforma y mejora. Frente a estos dos polos, la tarea del verdadero intelectual -nos enseñó Eco- consiste en analizar en profundidad y con rigor los mecanismos de la cultura de masas, con objeto de entenderlos para rescatar y aprovechar sus partes positivas, pero también para encontrar vías de reforma y mejora de las partes negativas (un "cauto dirigismo cultural"). Han pasado más de cincuenta años y las llamadas "nuevas tecnologías" han transformado la faz de la cultura de masas, hoy crecientemente canalizada a través de Internet y las redes sociales. Lo que fue saludado jubilosamente en un principio con práctica unanimidad por su enorme potencial en la democratización de la cultura y el conocimiento, no ha tardado en mostrar también sus enormes problemas. La erosión de la calidad de la información es quizá el más importante de ellos, hasta el punto de que hoy hablamos abiertamente de la era de la "posverdad". En este contexto, no es difícil reconocer a nuevos apocalípticos, que demonizan los avances tecnológicos y las nuevas formas de comunicación, y a nuevos integrados, que las celebran sin reflexión crítica y responsable. Urge, por tanto, recordar a Eco: intentar entender los nuevos aspectos de la cultura, para aprovecharnos de las nuevas posibilidades y proponer cómo mejorarla. Esto requiere de nuevos mecanismos, más complejos y sofisticados que en los años 60, y que ya no atañen sólo a las ciencias sociales, sino también a las matemáticas, la física estadística, la informática y la inteligencia artificial, como hemos visto aquí. Eco nos dejó en 2016, pero propongo que los demás nos dediquemos a esta tarea. De lo contrario, caeremos en la pasividad de los apocalípticos o de los integrados, y dejaremos el camino de la reforma libre sólo para aquellos que hoy dirigen la nueva cultura de masas: entre ellos, algunas de las empresas más poderosas del planeta.

(Publicado originalmente en SciLogs el 30/12/2016). |

AutorCarlos Sabín. Investigador Ramón y Cajal en el Departamento de Física Teórica de la Universidad Autónoma de Madrid. Desde 2015 hasta 2022 escribí el blog "Cuantos Completos" en la plataforma SciLogs de la revista "Investigación y Ciencia". Autor de "Verdades y mentiras de la física cuántica" amzn.to/3b4z1MO y "Física cuántica y relativista: más allá de nuestros sentidos" http://shorturl.at/bdLN0 Archivos

February 2024

Categorías

All

|

RSS Feed

RSS Feed